AEB,即自动紧急制动系统(Autonomous Emergency Brake),是一种由控制模块(ECU)、传感器模块、制动模块和车辆人机交互模块共同构成的汽车主动安全技术。其通过雷达或/和摄像头等目标检测手段实时监测车辆前方机动车、电动车、有人骑行的自行车及行人情况,判断出现潜在风险时系统将自动采取预警与制动措施,为安全出行保驾护航。

上期《制动课堂∣论AEB系统与自动驾驶安全性(下)》已经提到,尽管AEB系统对于减少路面交通事故发生率效果显著,但受限于当前技术水平,AEB仍存在着一定的感知与判定短板,因而并非自动驾驶防撞措施的终极选项。

本期我们将继续对AEB的行业标准进行解读,探讨这一技术的局限性与补足手段。

01 解读AEB行业标准

在NCAP早期,AEB仅仅对位于本车前方同向行驶的车辆有效,即NCAP场景中的CCRx(Car-to-Car Rear Stationary/Moving/Braking)等。在这样的情况下,对于感知系统的能力需求相对较低,仅需识别同向行驶的车辆,且能够在天候情况良好的白天正常发挥功能即可。

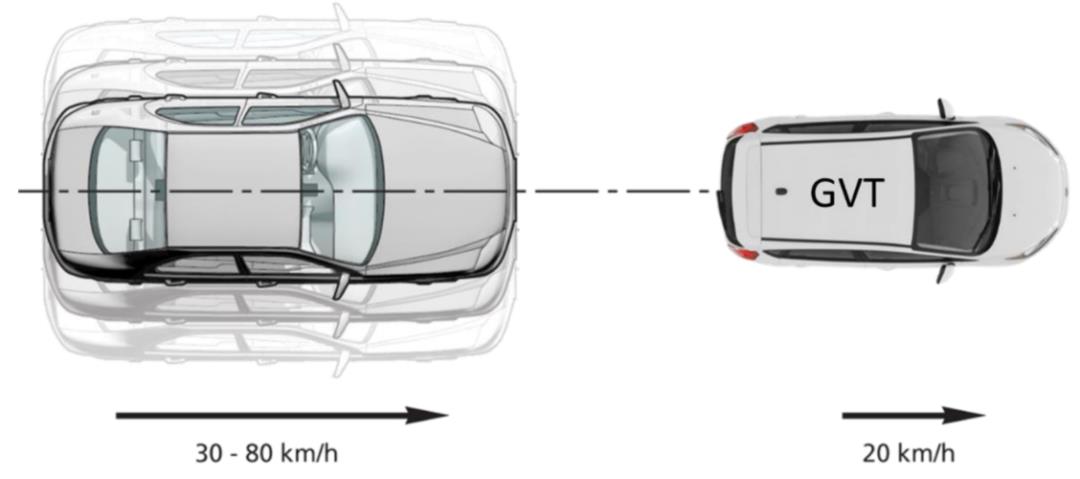

图:CCRm场景

图:CCRm场景

随着技术的发展以及NCAP场景的不断完善和推进,AEB的功能实现越来越具有挑战性,进而对其子系统要求也越来越高,以2018年E-NCAP为例:

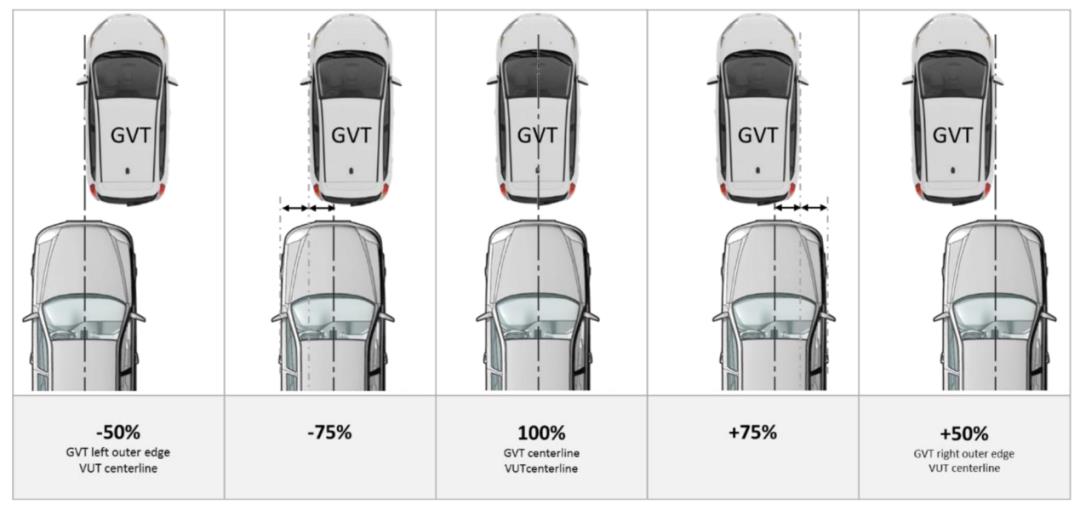

图:车对车不同重叠率

图:车对车不同重叠率

不同的重叠率为AEB带来了新的挑战。从前述AEB原理可知,当重叠率不同时,理论上所需的横向避撞操控要求也不尽相同。然而如果我们依然锁定一个阈值,例如以100%重叠时的场景为避免碰撞的基准,那么在±50%重叠率时,车辆则可能发生碰撞;反之,如果以±50%重叠率场景为避免碰撞的基准,那么在100%重叠率场景中,车辆刹停后可能距离前车较远。

左图:车对行人及自行车的AEB

右图:行人“鬼探头”场景

此类场景首先就需要AEB感知系统能够识别行人及(骑行中的)自行车,其次,此类场景为横穿场景,对于感知传感器而言,需要一定能力的水平视场角(FoV-Field of View)以及较早检测到目标,根据NCAP场景要求进行简单计算。对于安装在车辆正中的传感器而言,50-60°FoV可以满足需求。

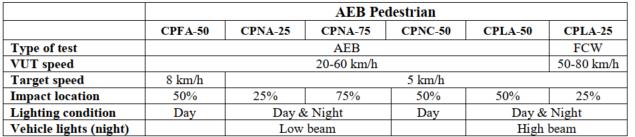

图:AEB行人夜间场景要求

图:AEB行人夜间场景要求

夜间场景的提出也进一步提高了对于AEB感知系统的要求,仅靠一定程度的环境光源加上车辆近/远光灯的照明条件实现AEB功能还是有相当的挑战。

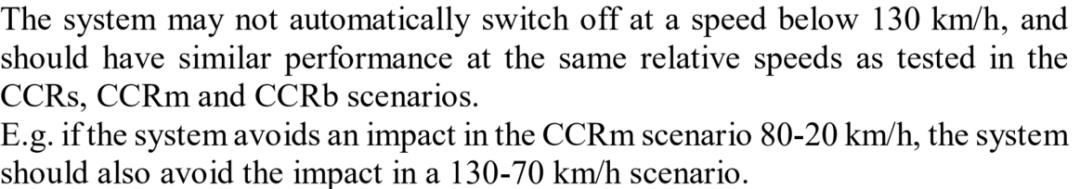

图:E-NCAP 2020新需求

图:E-NCAP 2020新需求

E-NCAP2020对于AEB感知系统性能的有效得分也提出了更高的要求,即车速最高提升至130kph,同时不能降低其速度降性能表现。这些要求进一步推进了AEB系统的ODD(Operational Designed Domain),要求厂商确保感知系统在高速下的感知能力以及决策单元的鲁棒性。需要特别指出的是,AEB误触发问题的其中一种解决方式就是去限制其ODD范围,而NCAP protocol的推进,也令误触发问题的处理更具难度。

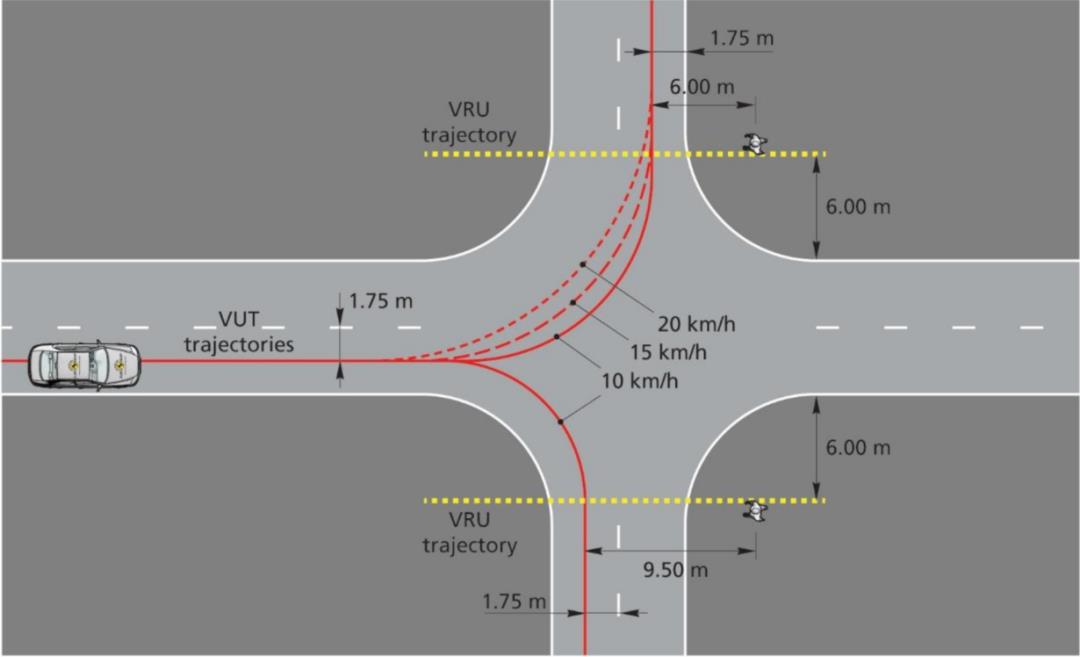

直至E-NCAP2020为止,AEB所应用的场景还是仅限于本车直行场景以及VRU(Vulnerable Road User弱势交通参与者)的低速横穿场景。而在E-NCAP2022场景中,新的场景要求为AEB带来了挑战性的变革。

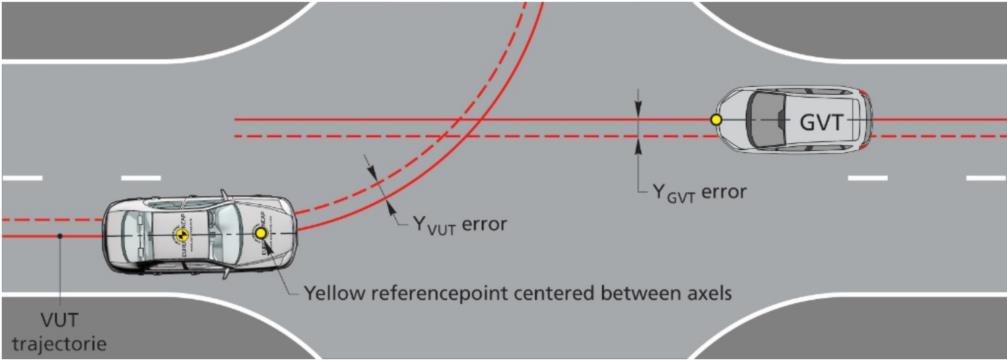

图:本车左转穿越对向来车场景

在上图的场景中,本车在路口进行左转,过程中与对向来车有碰撞风险,要求AEB介入。AEB感知系统需要早而准的检测到对向来车,而且在行进过程中,也要时刻对目标车辆进行准确跟踪,同时计算本车左转的弯道路径与目标的路径是否存在TTC(即碰撞风险)。

CPTA场景

(Car-to-Pedestrian Turn Adult)

类似的,上图场景是一个本车左转而对向行人横穿马路的场景,此时就要求本车感知系统拥有更宽的FoV,以提早发现行人并在整个过程中不丢失其行动轨迹。

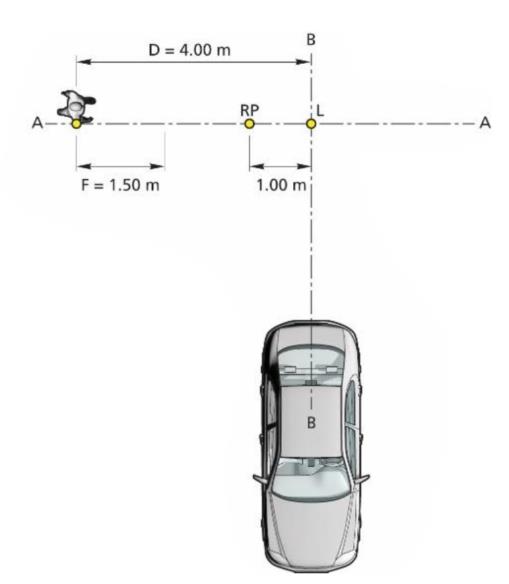

CPRA行人场景

(Car-to-Pedestrian Reverse Adult)

CPRA行人场景

(Car-to-Pedestrian Reverse Adult)

在NCAP2022中也出现了倒车AEB的场景,显然,AEB系统需要增加后方的感知能力并作出适当行动判断,目前业界大多是依靠超声波传感器(USS)辅以后泊车摄像头来实现这一点。除了倒车场景外,目前拥有100°以上FoV的单视觉摄像头能够应对大多数场景。但我们不得不考虑到未来NCAP的更多可能性:

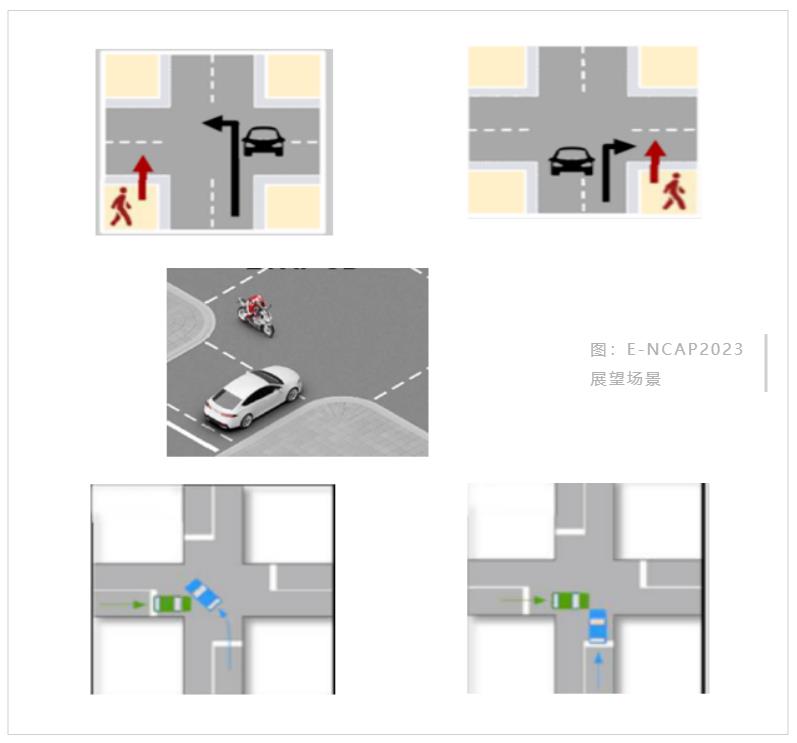

图:E-NCAP2023展望场景

图:E-NCAP2023展望场景

横穿场景的增多,尤其是高速横穿场景的加入,使得单一传感器已经很难解决感知问题,需要更多传感器加入以补足侧面感知不足的问题。复睿智行的毫米波雷达就能较好地辅助解决这些场景,其具备成本低、覆盖广、测距远、反应快等特点,可以作为视觉系统的良好搭档,快速提升有效目标的置信度,实现AEB高性能反应。

除了感知能力外,AEB系统的决策能力也需要加强,尤其是面对高速横穿场景。需要指出的是,刹车并不是避免碰撞的唯一选择(例如事实上可以通过加速来避免碰撞,而不恰当的刹车反而可能造成碰撞事故)。另外,在这种情况下,TTC就不是一个很好的衡量标准,应当与TTI/TTM (Time To Intersect/Time To Middle)代替/交互使用。

↑STA (Scooter Target Adult,类比于E-NCAP的PTW,Powered Two Wheeler)

02 AEB系统的短板

毫无疑问,AEB系统自面世以来,已经在避免/减缓交通事故发生,挽救生命及财产损失方面发货了重要作用。但无论是制造者还是使用者都需要认识到,AEB系统不是万能的,仍然存在着一定的短板。

如果对AEB进行评测的话,NCAP场景就是一套应试题,考生们可以通过不断地练习和“真题”测试获取高分。在这些测试中,不管是E-NCAP还是C-NCAP首先会先确定一种目标物(包括Dummy Vehicle,Dummy Pedestrian等),例如:

上图:假人 假自行车

下图:GVT假车 (Global Vehicle Target)

这些假人假车的“拟真”程度都是需要先经过各主要厂家的传感器测试过才能够定型的,采用不易撞坏、容易拆解和组装的轻质材料,价格不菲,一套造价通常在百万元以上。

而在现实中,AEB系统要经受各种磨练:

①正常感知能力的局限

◆感知系统对于动态目标的识别率优于静态目标的识别率

◆感知系统对于车尾的识别优于车身/车头的识别(受限于NCAP)

◆白天的效果优于晚上

②天候与环境

首先,单一传感器都有自己难以单独解决的问题,例如:前文提到的雷达对于路面环境金属物品的敏感性;摄像头在雨雪天气的局限性以及低日照(Low-sun)产生耀斑影响感知能力的问题;激光雷达在雨雾天气中性能降低的问题。通过传感器组合可以某种程度上提高系统的可用性,但成本与性能的平衡也需要考虑。比如在刚进入/驶出隧道时背景光突变的情况下,摄像头可能会出现问题,此时可以通过其他传感器组合进行弥补,例如毫米波雷达。

③误触发(FP-False Positive)与漏触发(FN-False Negative)

“高分”TP与“低能”FP之间是AEB永恒的话题,感知系统的不完美引入误差会使得FN/FP难以解决。前文提到NCAP测试中的多重叠率测试,假如重叠率低至1%时,“保证不碰撞”对于感知系统产生的目标框(BBox,代表目标位置及大小)准确性要求极高,这是由于目标框的不准确性,AEB系统一般倾向于将感知系统报告的目标框缩小以避免误触发。又如在转弯场景中,由于感知系统对于目标的航向角(heading)测量不够准确,在之前的系统中也倾向于将此类场景排除出AEB ODD范围,以减小误触发。

为了检测相关FP及FN,一般整车在SOP前需要实施不少于30万公里的实车测试与数据收集。一旦在过程中出现任何一例AEB触发事件,基本可以被判定为误触发,因为一般驾驶员,即使是属于激进型驾驶员,在普通道路上也基本不可能成功故意触发AEB。收集下来的数据可以反复进行数据回灌以对AEB软件进行测试,以保证在解决原有问题的基础上不产生新的问题。

④对广泛目标(General Object)的AEB

在更长的时间维度上,针对广泛目标的AEB是工程人员的终极目标。但就当前而言,实现起来非常困难。这些广泛目标包括雪糕筒,电线杆,隔离栏,墙壁等,目前尚没有哪一种传感器可以很好的识别。

⑤异形目标

当年特斯拉与一辆白色卡车的撞击引发了人们对于“自动驾驶”的广泛关注与质疑,但实际上,直到今天,这一问题也没有得到很好的解决。例如一辆超低平板车、三轮车,或者装载着大树,同时树梢伸出车厢/车板延伸到后方的卡车,这种特殊情况如何解决目标判定问题?这就是自动驾驶行业的长尾问题。

03 AEB未来路在何方

对于未来而言,更多传感器的接入会使得AEB的ODD更加广泛,更优秀的算法也会对AEB产生影响。例如:

◆夜视传感器加入AEB感知系统,极大的补充了夜晚光照条件不理想的场景;

◆对有效目标种类进一步丰富,除目前的车辆、VRU外,可能对于路肩、护栏也纳入AEB范围,常规目标的识别精度进一步提高;

◆增加驾驶员行为学习反馈功能,可以基于驾驶员对目标的反应进行自学习;

◆AEB的速度降不太可能进一步提高,假设车辆最大减速度为1g,刹车时间为最大1.5s,则速度降为50kph;如果进一步提高最大减速度,例如沃尔沃可以达到12m/s^2,速度降达到65kph,这也基本上已经达到了极限值。

但与此同时,从最近的E-NCAP的路线图也可以看出,通过AEB来进行避撞可能已经进入瓶颈期。虽然AEB的系统动作最符合“让速不让道”的道路安全行驶要求,但仅仅依靠减速在当前技术条件下已经达到了性能极限。

相对应的,早在2020年E-NCAP就已在相应的测试规范中指出,如果在较高速度AEB无法达成测试项目时,可以使用AES代替。在未来,AES(Autonomous Emergency Steering)的作用将进一步凸显,成为AEB系统的一大补足。